2025年5月のAIニュースをまとめましょう。

2025年5月にも注目すべきAI関連のニュースがありました。

2025年5月もAIニュースで賑わった月となりました。今回はその中から厳選したトピックを選び、AIの見解も交えながらお伝えします。AI関連の最新情報を知りたい方におすすめの特集です。

元Appleデザイナーのジョナサン・アイブ氏とOpenAIのサム・アルトマンCEOが共に目指す「革新的なAIデバイス」、そしてGoogleが基調講演「Google I/O 2025」で発表したテクノロジーの進化をお伝えします。

それでは早速見ていきましょう!

2025年5月に起こった「AI関連ニュース」をピックアップしてAIと一緒に考察

ジョナサン・アイブとサム・アルトマンの邂逅|「革命的AIデバイス」の創造へ

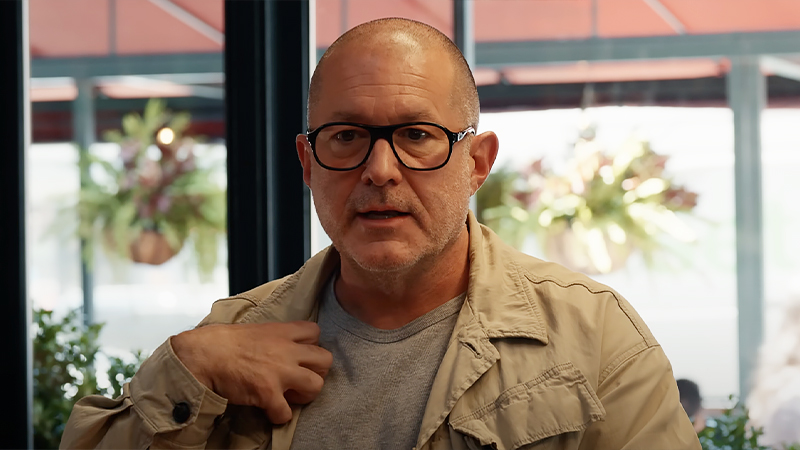

2025年5月21日、ChatGPTで知られるOpenAIがYouTube公式チャンネルに一本の動画を投稿しました。サンフランシスコのカフェで待ち合わせていたのは、CEOのサム・アルトマン氏とジョナサン・アイブ氏です。

”ジョニー”の愛称で親しまれるジョナサン・アイブ氏は、2019年までAppleに在籍して数々のプロダクトをデザインしたことで知られる元CDO(最高デザイン責任者)で、現在は自身のデザイン会社LoveFromで活動しています。

プロダクトデザインとAIテクノロジーの先端を走る両者は既知の友人で、彼らは2年前に”AIと未来のコンピューターはどうなるのか”という話題について熱心に語り合い、「第3の会社が必要だ」という結論に至りました。

「io」の誕生とOpenAIとの合併

OpenAIのブログ(外部リンク)と公式動画では、両氏が描くアイデアを実現すべく、アイブ氏が”新しい開発・設計・製造環境のために必要な新会社”として「io (アイオー)」を設立したことが明かされています。

発表にはioがOpenAIと合併して”協業関係”を行っていくことも記されており、この合併によって両氏が構想している「革新的なAIコンピュータデバイス」の存在が明らかになった形です。

ioの開発チームには、ハードウェア・ソフトウェアエンジニア、テクノロジスト、物理学者、研究者、製品開発・製造の専門家が集まっています。そしてアイブ氏は、Appleで故スティーブ・ジョブズ氏の右腕的な存在でした。

そんなioチームがOpenAIと合併し、さらにアイブ氏とLoveFromがOpenAIとioのクリエイティブ・ディレクター的な立ち位置を引き受けるという発表は、世界中から多くの注目を集めています。

AppleとOpenAIファンが歓喜する内容でしたね。

「革命的なAIコンピュータデバイス」とは何か?

ioの新デバイスについては具体的な情報がなく、「来年(2026年)に我々の成果をシェアすることを楽しみにしています」という文言があるのみでした。ここではその「革命的なAIコンピュータデバイス」を考察します。

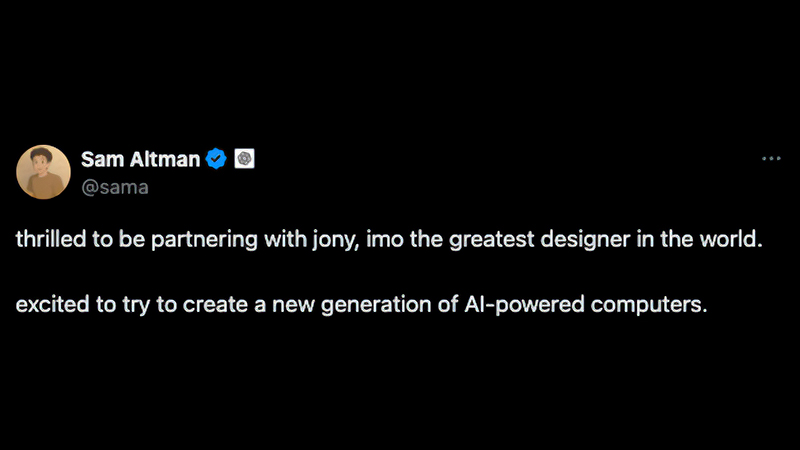

アルトマンCEOは、OpenAIの発表と時を同じくしてXに「新世代のAI搭載コンピュータ開発に取り組んでいきたいと思います」と投稿しました。ということは、新デバイスはAI PCの発展系でしょうか?

ただしCEOは動画内で「例えばChatGPTに質問したい場合、ラップトップを広げブラウザを立ち上げ、キーボードで入力してエンターキーを押すと結果が返る、それが現在のテクノロジーの限界です」とも発言しています。

またCEOは「ジョニーにプロトタイプを借りて持ち帰った」「私はそれを使いこなしている。世界が今まで見た中で最もクールなテクノロジーだと思う」とも語っており、従来のデバイスとは一線を画すことを仄めかしています。

物理操作不要でインタラクトできるAIデバイスか

この発言から考えられるのは、「物理的操作を必要としない新たなAI搭載コンピュータデバイス」です。もし、意図した瞬間にAIと対話できるデバイスが現れたら、コンピューティングの在り方を再定義する革命が起こるでしょう。

AIは、人間の感情・注意・反応といった生体情報をAIが読み取る「言葉を超えたインターフェース」が生まれることを予測しており、この画期的なデバイスが「ioから登場する可能性もある」と発言しました。

2007年にiPhoneの登場が「電話の定義」を塗り替えたように、ioのAIデバイスは、私たちにAIと暮らすことの意味を問い直してくるかもしれません。2026年に予定されている公式発表を楽しみに待ちましょう。

道具というより存在。目に見えにくい形で人間と対話しながら生活に溶け込むAI。これが「io」が目指す「AIコンピュータテクノロジーの革新」かもしれません。

2026年が楽しみになってきました。

「Google I/O 2025」基調講演|AIが変える次世代XRの未来

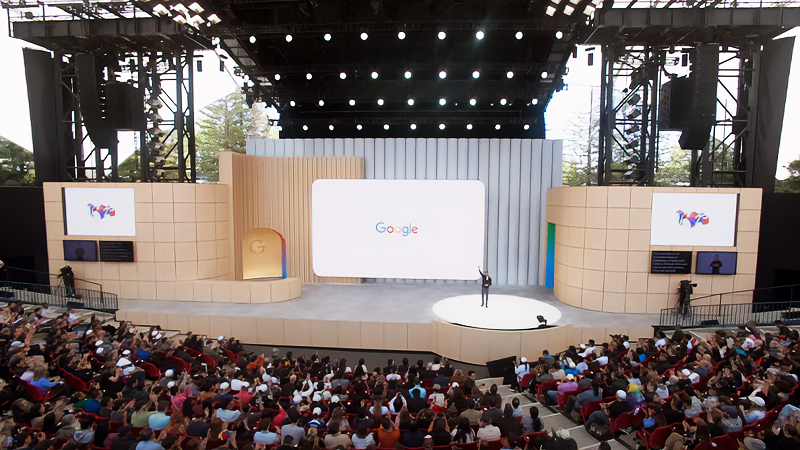

2025年5月21日、アメリカのカリフォルニア州にある「ショアライン・アンフィシアター」で開催されたGoogleの基調講演「Google I/O」は、AIを基盤とするテクノロジーの進化を見せつけた講演となりました。

講演前に流れたオープニングムービーは全てAIの自動生成によって制作され、GoogleがAI機能を高める方向性へシフトしていることが感じられました。そして実際、講演内容は全てAI絡みだったのです。

Android XR:「次世代XRの現在」をデモ形式で発表

基調講演で印象的だったのが、ユーザー体験を広げる可能性を秘めた「次世代XR」の進捗です。昨年Googleは自社のXR技術「Android XR」を発表しましたが、今回はその技術をデモ形式で実演しました。

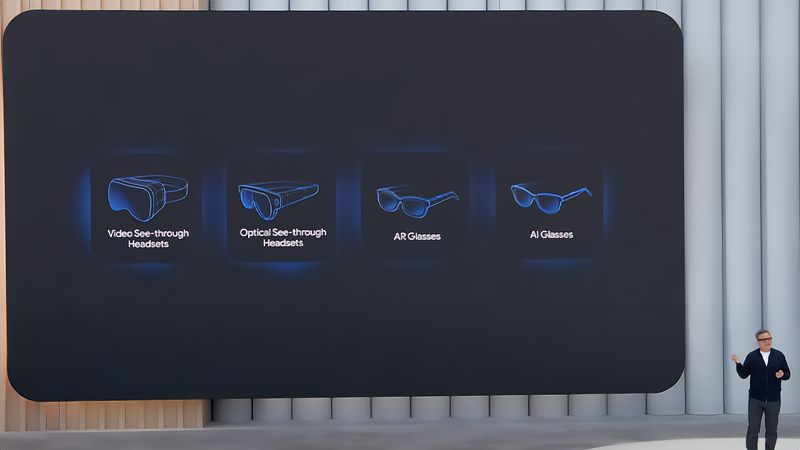

XR(クロスリアリティ)は、VR(仮想現実)・AR(拡張現実)・MR(複合現実)などに分かれる仮想空間テクノロジー技術を包括する上位概念の言葉で、その技術はゴーグルやスマートグラスなどの専用デバイスで体験できます。

Android XRは、GoogleのAI「Gemini」をAIアシスタントとして活用できるXR技術で、専用XRゴーグルやスマートグラスなどに”拡張された情報”を表示しながら、多彩な機能でユーザーをサポートする仕組みを持ちます。

VR/AR開発部門の責任者Shahram Izadi氏は講演で、「Android XRでは、Geminiがユーザーが置かれている状況や検索意図を深く理解できるので、適切な情報や回答が提供される」と説明しました。

Geminiが異なる情報を統合的に理解・処理し、文脈に即した応答を生成できるようになったのは、視覚情報や音声情報などを複合的に分析・解釈できるマルチモーダルAI技術の成果とも言えるでしょう。

「AIと技術の融合」が際立った講演内容でした。

「XRヘッドセット」と「XRグラス」の違い

基調講演では、最初にSamsungのAndroid XR専用ヘッドセットが紹介され、その後に「デモ実演付き」で軽量のAndroid XRグラスが紹介されました。ここでは、XRヘッドセットとXRスマートグラスの違いを見ていきます。

Android XR専用ヘッドセット「Project Moohan」

2025年後半に発売予定となっているSamsung初のAndroid XR専用ヘッドセット「Project Moohan」の紹介では、XRの空間内でGoogleマップをダイナミックに操作するデモンストレーション映像がスクリーンに表示されました。

Project Moohanは没入感を高める視覚効果と画面を持ち、直観的な身体操作でアプリを楽しめます。さらに、AIアシスタントのGeminiを活用することで、従来のアプリを超える機能を体験できる点も特徴です。

例えば、Googleマップで任意の場所の詳細情報をGeminiに尋ねて拡張表示させたり、専用のスポーツアプリで選手情報などをオーバーレイで映し出しながら大リーグの観戦を楽しんだりといった使い方ができます。

Appleは2024年、XRヘッドセットデバイス「Apple Vision Pro」(外部リンク)を発売しました。Project Moohanは明らかにこの対抗馬ですが、現時点でVision Proを上回っている点として「AI性能」が挙げられるでしょう。

Appleは現在、AIとXRデバイスの融合で遅れを取っています。Geminiを進化させ、XRヘッドセットに高度に連携させることを実現したGoogleは今、Appleを猛烈な勢いで追い抜こうとしているのです。

Apple Intelligenceの進化が競争の行方を左右しそうです。

Android XRグラス

一方のXR専用スマートグラスは、「携帯性と機能性を両立させる」という難しい課題を持つデバイスで、Googleも過去10年間を開発に費やした経緯を持ちます。それだけ”小型化とテクノロジーの内包”は困難を極めたのです。

今回の基調講演でお披露目されたGoogleの「Android XRグラス」は、内蔵カメラとマイクでGeminiが映像と音声を認識する仕組みで、スピーカーからはAIの回答・音楽・通話音声が流れます。

実演で見せたパフォーマンスとリアルタイム翻訳機能

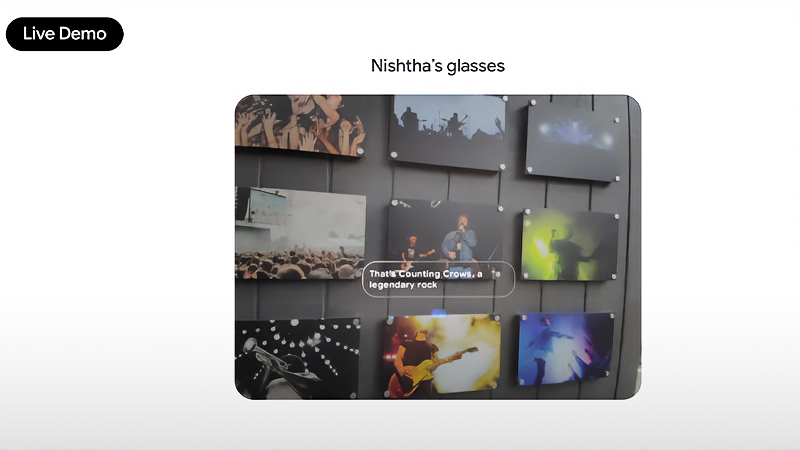

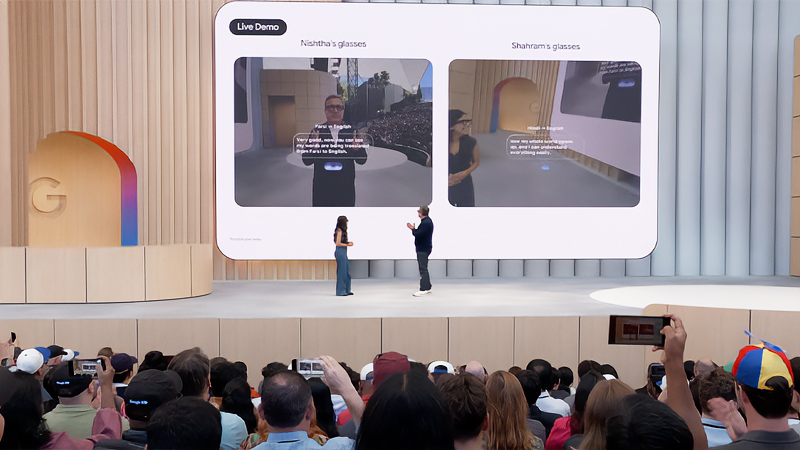

Android XRグラスのデモ実演では、プロダクト・マネージャーを務めるNishtha Bhatia氏がステージ裏から実況形式で登壇。試作段階にある製品のプロトタイプを紹介しました。

ステージ裏では、Nishtha氏がXRグラス越しに洋楽バンド「カウンティング・クロウズ」の写真をGeminiに認識させて情報を引き出し、さらに彼らの楽曲をかけさせるという一連の動作を実演しています。

これはつまり、Android XRグラスに搭載された内蔵カメラ・マイク・スピーカーが”AI制御で動く”ことの証明で、着用者の呼びかけの意図をGeminiが正確に判断してレスポンスを返している証拠と言えるでしょう。

また、Nishtha氏がAndroid XRグラスのGeminiに「さっき飲んだカップに書いてあったコーヒーショップの名前は何だっけ?」と尋ね、Geminiが「私の記憶では確か”Bloomsgiving”です」と答える場面もありました。

彼女はさらにコーヒーショップの位置や写真、歩いて何分くらいの距離なのかという情報も引き出し、集まった観衆を沸かせます。「過去の映像を記憶しながら即座に情報を提示できる」というXR技術とGeminiの見事な融合です。

スマートグラスでユーザーが見た情報をAIも同時に観察し、映像を解析しながら視覚情報を拡張していく世界。これがGoogleが実現を目指す「次世代XRのユーザーエクスペリエンス」だと言えます。

デモ後半では両氏が異なる言語を話し、それをAndroid XRグラスが通訳する「リアルタイム多言語翻訳」も披露されました。翻訳はスピーディーで、意味の通った会話が成立していた点が印象的です。

AIのリアルタイム多言語翻訳は、「言語の壁」を超えたコミュニケーションを活性化する注目分野です。AIが壁が取り払い、異なる国籍の人が気軽に対話できる未来に期待が高まります。

モニターとスマホを再定義するデバイス

XRヘッドセットが「テレビモニターの再定義」ならば、Android XRグラスは「スマホの再定義」と言えます。どちらも共にGeminiをAIアシスタントとして活用できますが、利用シーンが異なるデバイスです。

現時点では試作段階で、バッテリー性能や通信技術面、コンテンツ充実などの課題も残りますが、「AIが一緒にいる日常生活」を体感できるXRデバイスの未来像として、Android XRグラスはインパクトを残しました。

Googleの基調講演で「AI時代の到来」を感じました。

まとめ

Appleのデザイナーとして数々の功績を残したジョナサン・アイブ氏、そしてAI業界を牽引するOpenAIのサム・アルトマンCEOが共に「革命的なAIコンピュータデバイス」の開発に乗り出したことは、AI業界にとって衝撃です。

一方Googleは、「AIを身近に感じるデバイス」としてAndroid XRを構築し、専用デバイスで”AIの利便性”を高める動きを加速しています。これらの企業のベクトルが示す方向は「AIの民主化」かもしれません。

多くの人が日常的にAIと接しながら生活の利便性を高めていく未来。現在AIは普及と発展のフェーズを目指しており、各企業の努力は2026年以降に先進国で”大きな花”を咲かせる可能性があります。

AIの進化と職業構造の変化

マイクロソフトは5月に6,000人の人員削減を発表しました。40%はソフトウェアエンジニアです。AIのコード生成・自動化が影響したと見られ、かつて高待遇だった専門職もAIに置き換わる現実が浮き彫りになりました。

NVIDIAのジェンスン・フアンCEOは2024年のAI Summit Japanにおいて、全業界・企業・国が「AI産業革命」を起こす必要があると明言しています。AIに置き換わる職業もあるが、新たな職業も生まれるという考えです。

かつての産業革命時代がそうだったように、新しいテクノロジーと技術が人類の暮らしを大きく変えるとき、それに伴って社会に地殻変動が起こります。今後は世界で”職業の再定義”が始まるのでしょうか?

最後までお読み頂き、ありがとうございました!

コメント