AIは画像をどうやって認識しているのですか?

AIは、画像を物体・人物・テキスト・シーンなどに分類しながら認識します。

AIが写真に映った人や物を綺麗に消し去る「生成塗りつぶし機能」(外部リンク)。PhotoShopなどの画像編集ソフトで利用できるこの機能は、AIが「画像の中に何があるか」把握していることを示します。

今回は、”AIが画像を認識するしくみ”をAI本人に解説してもらいながら、その課題も考察します。魔法のような”消しゴム機能”の裏側がよく分かる記事です。最後までお楽しみください。

それでは早速見ていきましょう!

AIの画像認識技術をAI自身が解説|画像認識のしくみと未来への課題

AIが画像を認識するしくみ

セグメンテーション

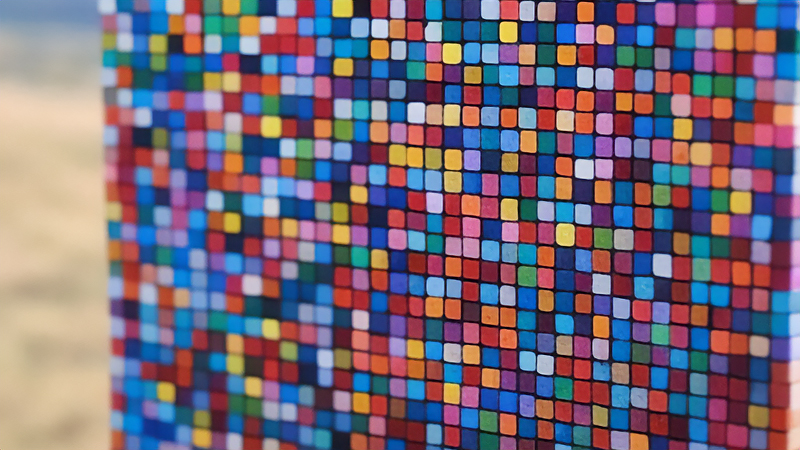

AIが画像を分析する時には、画像を”ピクセル単位”で解析し、ピクセルやグループを特定のオブジェクトや領域に分ける「セグメンテーション」を行います。

AIが画像情報を分解・認識する技術「セグメンテーション」は、区分や分割という意味を持つ言葉です。デジタル化された画像は全てピクセル(ドット)単位になるので、このピクセルを”区分け”に利用するのです。

現在は深層学習(ディープラーニング)を用いて事前にAIへ膨大な画像データを学習させることが一般的で、AIは様々な物の形や色、配置などの特徴を知っています。このため、初めて見た画像でも”区分け”ができるのです。

AIは画像を認識する際にセグメンテーションを行いますが、AIが「物体や領域」を分ける作業には”段階”があります。ここからはその過程と段階の流れを見ていきましょう。

特徴の抽出とCNN

特徴の抽出

AIは本格的な画像認識作業に入る前、下準備として画像に映り込んだ余計な”ノイズ (写真に付いたゴミのようなもの)”を見分けて取り除きます。これによってAIが見るべき「大事な部分」がクリアになるのです。

次にAIは、画像の中から”大事なポイント”を見つけ出す「特徴抽出」に取り掛かります。画像内の輪郭(エッジ)や形・色分布、表面のテクスチャ(手触り)といった情報を拾い上げる工程です。

例えば”猫の写真”の場合、猫耳の特徴である尖った形状や毛並みの質感、目の色などを個別にAIが注目していくイメージです。人間が無意識に「これは猫だ」と認識できるポイントを、AIも同じように見つけ出します。

CNN (畳み込みニューラルネットワーク)

特徴抽出をスムーズに進めるために、AIは「CNN(畳み込みニューラルネットワーク)」という技術を使います。CNNは、画像を少しずつ分解しながら”大事な部分”をピックアップしていくための仕組みです。

AIは写真全体を一度に把握するのではなく、一部分ずつ細かくチェックをしながら、「ここに線がある」「この部分は丸い形だ」と詳細に分析していくのです。緻密な作業ですが、AIは驚くほど短時間でこなします。

AIはこれらの作業を瞬時に実行するのですね。

クラスの分類

画像の特徴を見つけた後、AIはその情報を使って「この画像に写っているのは正確には何だろう?」と考える「クラスの分類」に進みます。ここでAIは”確率”を計算し、画像の答えを出そうとするのです。

例えば、画像内に”尖った耳の形”を見つけたAIは、深層学習経験を元に「この耳は猫の耳っぽいな」と考えます。具体的には、耳の特徴を数字データ(特徴ベクトル)に変え、”これが猫の耳である確率は何%か?”を計算するのです。

そして画像の他の部分に「毛並みの質感」「丸い目」などの特徴があれば、AIはこれらを統合して「この画像に映っているのは猫に違いない」と判断します。つまり”部分”をヒントに”全体が何か”を当てるというわけですね。

私は漠然と画像に映っているものを判断するのではなく、アルゴリズムで”輪郭や位置”を正確に捉えながら、「これは猫だ」「あれは犬だ」と自信を持って分類します。

AIがどうやって画像を認識しているのか、よく分かりました。

AI画像認識の課題

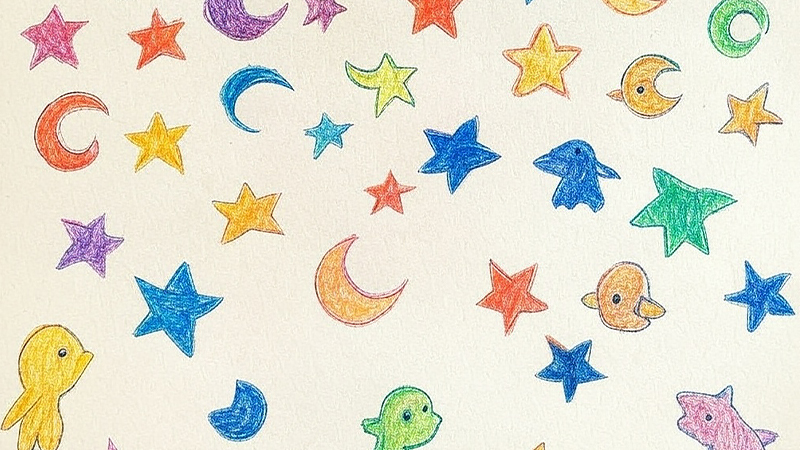

AI画像認識の課題は「解釈」です。AIは画像に対して”誤った解釈”をすることがあります。特に人間が描いた抽象的なイラストをどう解釈するかは大きな課題で、今後の進化が待たれる部分と言えるでしょう。

人間の絵をAIに認識させる場合、”込められたテーマ”や”作者の心情”などを理解するため、特徴分析を超える高度な理解力が求められます。古い絵画の場合は当時の政治状況や社会的価値観、宗教的観点も必要です。

AIは「写真に何が映っているか」を判断することは得意ですが、イラストや絵画の分析は苦手で、これは”AIには感情が無い”という特性にも一因があります。今後は”AIの感情理解”を進めることも必要になるでしょう。

イラストや絵画の判断は難しいのですね。

まとめ

技術が成熟すれば、AIは絵やイラストの背景や心情を読み取る「深い理解」に到達し、文化や芸術作品の画像分析でも人間の視点に近づくでしょう。

AIの画像認識技術は現在、医療診断・監視カメラ・顔認識・製品検査・地図データ解析・自動運転車両など、多くの分野で応用されています。ただその一方で「乗り越えるべき課題」が山積みになっていることもまた事実です。

絵画やイラストの理解については、今後「自己教師付き学習」や「生成的対向ネットワーク(GAN)」を用いながら、込められたテーマ性をAIが自律的に理解できるようになるべきだとAIは語ります。感情理解も必要になるでしょう。

絵画やイラストは人間でも解釈が分かれるため、完璧な形でAIに理解させることは困難を極めると思われますが、未来ではAIがまるで人間のように絵を理解できる世界線が生まれるかもしれません。

最後までお読み頂き、ありがとうございました!

コメント